Source de l’image à la une : Pexels

Ia Soutenue Apple Google Révèle — l’essentiel à retenir.

Récemment, une IA soutenue par Apple et Google révèle des milliers de vulnérabilités dans des logiciels largement utilisés. Pourtant, cette avancée technologique se heurte à des défis notables, notamment dans l’évaluation de l’exploitabilité des failles détectées. De ce fait, de nombreux programmes de primes pour les chercheurs de bugs ont dû suspendre leurs paiements en raison d’un afflux massif de rapports, souvent accompagnés de faux positifs.

Les capacités de l’IA dans la détection de failles – Ia Soutenue Apple Google Révèle

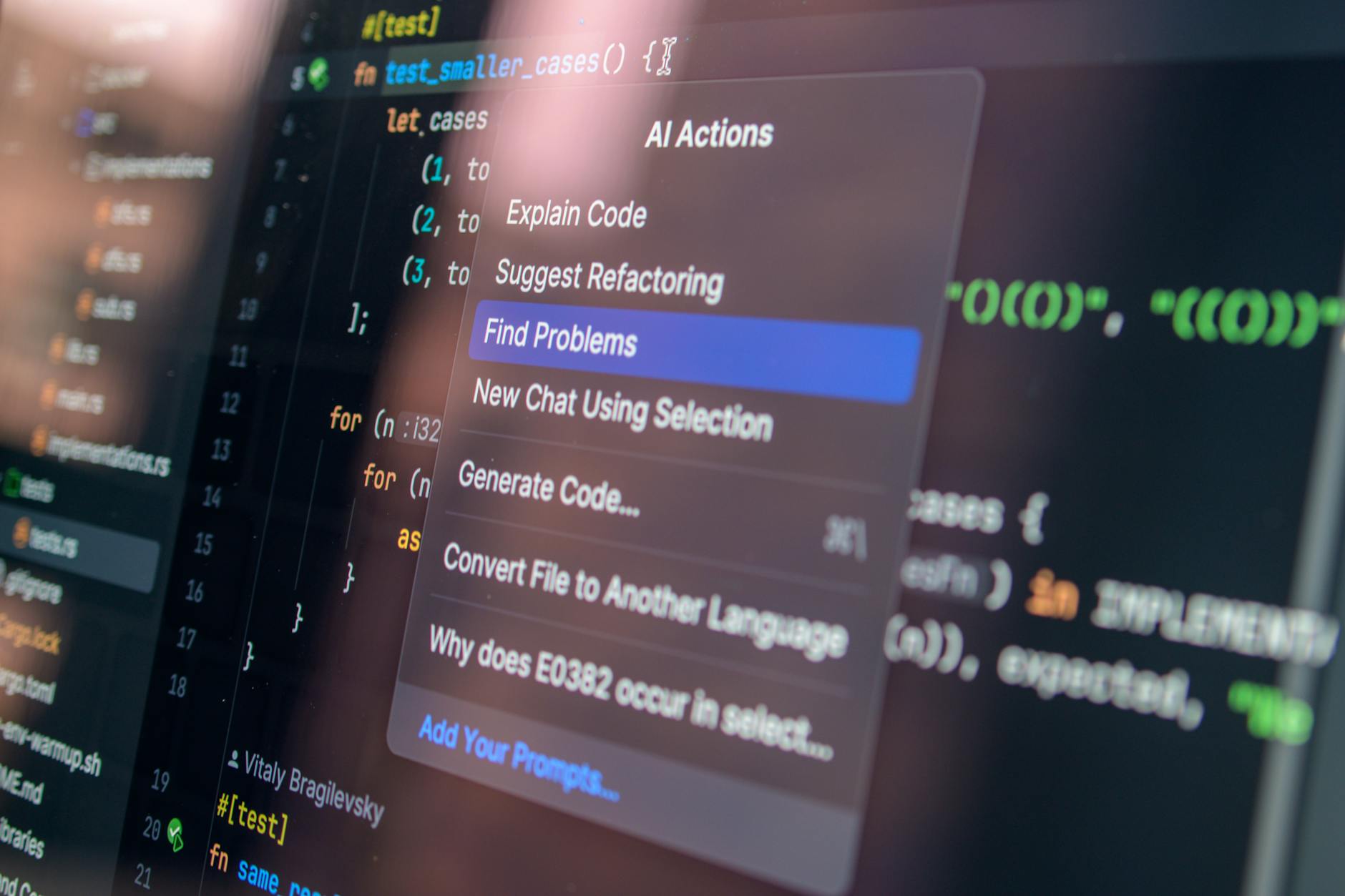

Les systèmes d’IA, développés par des géants comme Apple et Google, se distinguent par leur capacité à traiter d’énormes quantités de données pour identifier les vulnérabilités. Grâce à l’apprentissage automatique, ces plateformes peuvent analyser le code et relever les anomalies qui pourraient indiquer des failles de sécurité. Par exemple, elles peuvent examiner les bibliothèques de code ouvertes, ainsi que les logiciels populaires, pour repérer des erreurs potentielles avant qu’elles ne soient exploitées par des cybercriminels.

Toutefois, ces systèmes ne sont pas infaillibles. D’après les experts, une part importante des rapports générés par ces IA relèvent d’erreurs. Les fausse alertes peuvent surcharger les équipes de sécurité, entraînant une perte de confiance dans les outils d’automatisation. Cette situation a conduit à la suspension de certains programmes de primes. Par conséquent, les chercheurs de sécurité doivent faire face à une perte significative de revenus, ce qui nuit à leur motivation.

Les défis de l’exploitabilité

Un des principaux défis de l’IA dans ce contexte est son incapacité à déterminer l’exploitabilité des vulnérabilités détectées. L’IA peut manquer des subtilités qui définissent si une faille est réellement exploitable dans la pratique. Cette situation renvoie à une complexité inhérente au domaine de la cybersécurité, où les contextes d’utilisation et l’environnement des logiciels jouent un rôle crucial.

Les systèmes IA, même s’ils sont de plus en plus sophistiqués, requièrent encore l’expertise humaine pour valider les alertes. Les chercheurs doivent évaluer chaque signalement pour déterminer s’il mérite une attention particulière. En conséquence, ils se retrouvent souvent débordés, ce qui contribue à la suspension des paiements pour les rapports valides, par crainte d’un trop grand nombre de faux positives.

Conséquences sur les programmes de prime pour les bugs

En raison des problèmes évoqués, les programmes de primes pour la découverte de failles ont été contraints d’adapter leurs critères de rémunération. Certains ont décidé de suspendre leurs paiements, ce qui a créé un climat d’inquiétude parmi les chasseurs de failles. Par exemple, HackerOne, une plateforme largement utilisée dans ce domaine, a connu une baisse significative de la confiance des chercheurs suite à la surcharge d’informations inutiles générée par l’IA.

De plus, certains projets de logiciels ont choisi de se détourner complétement de ces systèmes automatisés, préférant se reposer sur des audits humains. Cela souligne les limites actuelles de l’IA dans la gestion des failles de sécurité, la collaboration humaine restant essentielle pour une analyse approfondie.

Perspectives

À court terme, il est prévisible que les entreprises continuent de souffrir du phénomène des faux positifs. Les outils d’IA devront évoluer pour réduire ces erreurs, en intégrant des mécanismes de filtrage plus sophistiqués. Les chercheurs de sécurité devront s’adapter et trouver des moyens efficaces de travailler avec ces nouveaux outils tout en validant minutieusement les alertes générées.

À moyen terme, l’industrie pourrait connaître une convergence entre l’expertise humaine et l’automatisation. Des solutions hybrides pourraient également émerger, où l’IA et les humains colleraient (au lieu de s’opposer) pour prioriser les alertes et optimiser les ressources. Cette approche pourrait augmenter l’efficacité des programmes de primes, tout en maintenant l’engagement des chercheurs.

À long terme, il est envisageable que des normes et des réglementations soient établies pour encadrer l’utilisation de l’IA en cybersécurité. De nouvelles alliances pourraient naître entre développeurs de logiciels, chercheurs de sécurité et entreprises technologiques. Ces collaborations pourraient finalement transformer la manière dont nous abordons la sécurité des logiciels dans un monde de plus en plus connecté.

FAQ

Qu’est-ce qui a conduit à la suspension des paiements des primes par les programmes de chasseurs de failles ?

La suspension des paiements est principalement due à l’augmentation des faux positifs générés par les systèmes d’IA. Ces outils, bien qu’efficaces pour identifier des vulnérabilités, ont souvent produit trop de rapports inexacts, surchargeant les équipes de sécurité. Cela a conduit à une remise en question de la fiabilité de ces systèmes et à une réaction prudente des programmes de primes.

Comment les chercheurs de sécurité s’adaptent-ils à ces nouveaux défis ?

Les chercheurs de sécurité adoptaient diverses stratégies pour accueillir ces nouveaux défis. Ils apprennent à utiliser l’IA comme un outil complémentaire, mais non exclusif, à leur expertise. De plus, ils développent des protocoles pour mieux filtrer les alertes et gérer efficacement le volume d’informations qu’ils reçoivent, tout en préservant leur rôle central dans le processus de vérification.

Quelles sont les attentes pour l’avenir des programmes de primes pour la découverte de failles ?

A l’avenir, nous pouvons anticiper une série d’ajustements dans le fonctionnement des programmes de primes. Notamment, les entreprises pourraient implémenter des normes de validation plus strictes ou des systèmes d’évaluation de la fiabilité pour les rapports. Cela pourrait restaurer la confiance des chercheurs et rendre ces initiatives plus viables sur le long terme.

Ce qu’il faut retenir

- Une IA soutenue par Apple et Google détecte des milliers de failles.

- Les faux positifs surchargent les équipes de sécurité.

- Des programmes de primes suspendent leurs paiements par précaution.

- Une collaboration humaine-IA est essentielle pour une cybersécurité efficace.

« `